Sioux Technologies entwickelt und implementiert Edge-KI-Lösungen, die geschäftskritische und zeitkritische Anwendungen künstlicher Intelligenz schneller, stabiler, sicherer und kostengünstiger machen.

Die Leistungsfähigkeit künstlicher Intelligenz (KI) ist nahezu grenzenlos und wird beispielsweise zur Optimierung von Fertigungsprozessen, medizinischer Diagnostik und autonomer Mobilität vielfach eingesetzt. KI läuft mittlerweile oft noch in der Cloud. Geräte sammeln Daten, beispielsweise mit Sensorik, und senden sie dann zur Verarbeitung mit intelligenten Algorithmen in die Cloud.

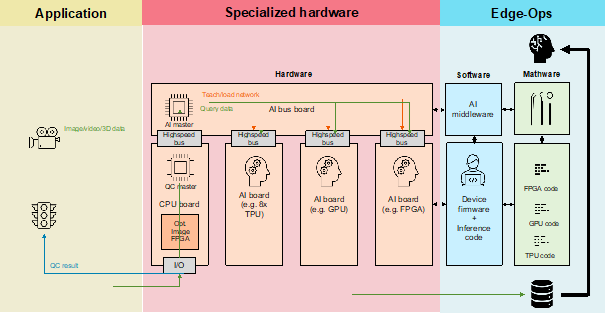

Bei Edge AI hingegen laufen diese Algorithmen lokal: auf dem Gerät selbst. Eine ständige Verbindung zur Cloud und das ständige Hin- und Herschicken von Daten entfällt somit. Dies bietet große Vorteile für geschäftskritische und zeitkritische Anwendungen: Es verhindert Latenzen/Verzögerungen und erhöht die Zuverlässigkeit, Cybersicherheit und Kosteneffizienz. Das Versprechen von Edge AI ist also großartig. Der Wechsel von der Cloud zum Edge stellt jedoch eine technologische Herausforderung dar, und die richtigen Entscheidungen zu treffen erfordert komplexe Kompromisse zwischen Leistung, Kosten, Stromverbrauch und einfacher Integration. Sioux unterstützt Kunden bei diesem Übergang.

KI-Modelle werden typischerweise für leistungsstarke High-Tech-Systeme mit praktisch unbegrenzten Ressourcen entwickelt. Aber wie stellt man sicher, dass Algorithmen lokal funktionieren und innerhalb der Einschränkungen der realen Welt, beispielsweise in Bezug auf Rechenleistung und Stromverbrauch, maximale Leistung erbringen? Erstens erfordert es Systemdenken und die Kombination von Spezialwissen über künstliche Intelligenz, Elektronik und eingebettete Software. Darüber hinaus ist unter anderem eine nahtlose Anbindung an die spezifischen Informationsbedürfnisse und Technologien des Kunden erforderlich.

Hier liegt die Stärke der Sioux. Unsere Lösungen im Bereich Edge AI reichen von der Anpassung vorhandener Algorithmen für den lokalen Einsatz über die Optimierung von KI-Modellen für bestmögliche Performance bis hin zur Produktentwicklung und -wartung. Damit unterstützt Sioux Kunden bei der Entwicklung und Implementierung robuster, erschwinglicher und skalierbarer Edge-KI, die einen echten Unterschied für den Erfolg ihrer Anwendungen macht.

Sioux unterstützt Kunden mit einem systemischen Ansatz für Edge AI. Wir bieten die erforderliche Elektronikauswahl und die erforderlichen Modifikationen der künstlichen Intelligenz und stellen so das beste Ergebnis in der Kombination von Leistung, Kosten und anderen Anforderungen sicher.